优化选择

回归模型预测结果很差,怎么办?

- 1 获得更多的训练实例;

- 2 尝试减少特征的数量 –减少过拟合;

- 3尝试获得更多的特征–欠拟合,有效的特征数偏少;

- 4 尝试增加二项式特征– 如 $x_1^2,x_2^2, x_1*x_2$ 模型选择问题;

- 5 尝试减少归一化程度$\lambda$ ;

- 6 尝试增加归一化程度$\lambda$ ;

这些办法也不是随机选择的,需要运用一些分析,帮助你知道问题所在;

假设评估 evaluating hypothesis

- 评估训练得到的假设Hypothesis;

- 数据分成训练集和测试集,通常用70%的数据作为训练集,用剩下30%的数据作为测试集;

- 训练集和测试集均要含有各种类型的数据;

通常要对数据进行“洗牌”:randomly shuffle,保证数据的均匀分布,然后再分成训练集和测试集。

测试集评估

对测试集运用该模型,我们有两种方式计算误差:

- 对于线性回归模型,我们利用测试集数据计算代价函数J ;

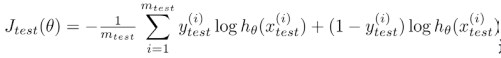

- 对于逻辑回归模型,我们除了可以利用测试数据集来计算代价函数外:

还可以计算错误分类的比率,对于每一个测试集实例,计算:

交叉验证-模型选择

- 我们有多个相类似的模型,如何选择出”最好”的模型?

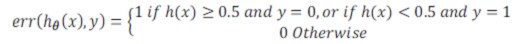

- 假设我们要在10个不同次数的二项式模型之间进行选择:

- 越高次数的二项式模型越能够适应我们的训练数据集,但并不代表着能推广至一般情况,我们应该选择一个更能适应一般情况的模型:泛化。

步骤

使用交叉验证集来帮助选择模型:

- 1训练集拆分:

- 使用60%的数据作为训练集;

- 使用39%的数据作为交叉验证集;

- 使用39%的数据作为测试集;

- 2 使用训练集训练出10个模型;

- 3 用10个模型分别对交叉验证集计算得出交叉验证误差(代价函数的值);

- 4 选取代价函数值最小的模型;

- 5 用步骤4中选出的模型对测试集计算得出推广误差(代价函数的值);

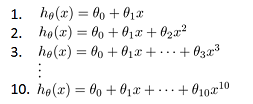

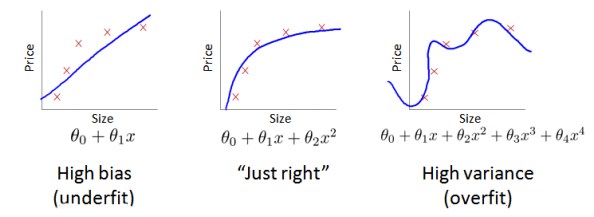

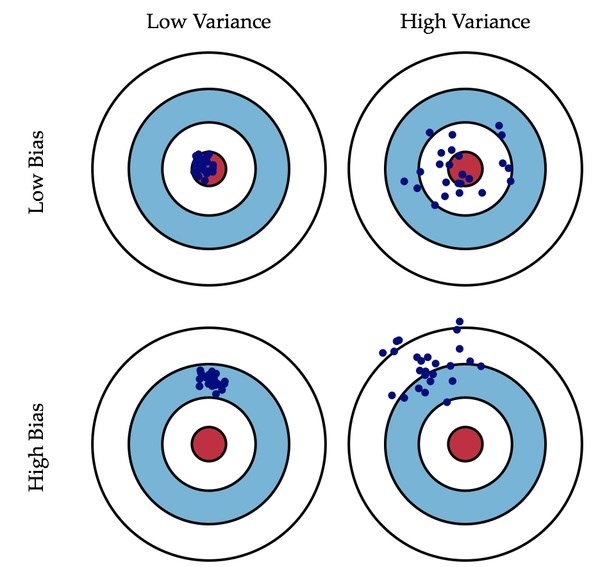

偏倚和偏差诊断(DIAGNOSIS BIAS VS. VARIANCE)

- bias: 偏倚,与实际的线路偏差了-欠拟合;

- variance/偏差:方差,过拟合造成曲线过于频繁上下波动,方差也就大;我们想让曲线更平滑一些,所以说过拟合的情况为high variance。

诊断

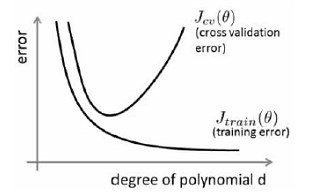

将训练集和交叉验证集的代价函数误差与多项式的次数绘制在同一张图表上来帮助分析:

- 1 d较小时, 训练集和交叉验证集误差近似,且误差均比较大,随着d增加而同时减少;

- 2 当d增大时,交叉验证集误差呈现先减小后增大的趋势,转折点是我们的模型开始过拟合训练数据集的时候。

3 d增大, 训练集误差一直减少,直到过拟合;

交叉验证集误差较大,我们如何判断是偏倚还是偏差呢?

- 1 训练集误差和交叉验证集误差近似时: bias偏倚/低拟合;

- 2 交叉验证集误差远大于训练集误差时: variance偏差/过拟合 ;

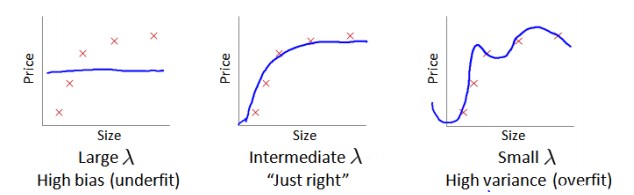

归一化与偏倚/偏差

一般会使用一些归一化方法来防止过拟合。但是我们可能会归一化的程度太高或太小了:

选择一系列的想要测试的$\lambda$ 值,通常是0-10之间的呈现2倍关系的值(如:0,0.01,0.02,0.04,0.08,0.15,0.32,0.64,1.28,2.56,5.12,10共12个)。

选择$\lambda$ 的方法为:

- 1 使用训练集训练出12个不同程度归一化的模型;

- 2 用12个模型分别对交叉验证集计算的出交叉验证误差;

- 3 选择得出交叉验证误差最小的模型;

- 4 运用步骤3中选出模型对测试集计算得出推广误差;

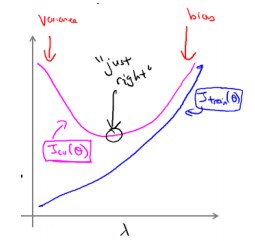

也可以同时将训练集和交叉验证集模型的代价函数误差与$\lambda$ 的值绘制在一张图表上.

- 当$\lambda$ 较小时,训练集误差较小(过拟合) 而交叉验证集误差较大;

- 随着$\lambda$ 的增加,训练集误差不断增加(低拟合),而交叉验证集误差则是先减小后增加;

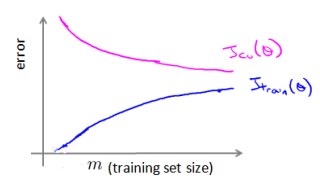

学习曲线(LEARNING CURVES)

- 学习曲线是将训练集误差和交叉验证集误差作为训练集实例数量(m)的函数绘制的图表。

- 当训练较少行数据的时候,训练的模型将能够非常完美地适应较少的训练数据,但是训练出来的模型却不能很好地适应交叉验证集数据或测试集数据。

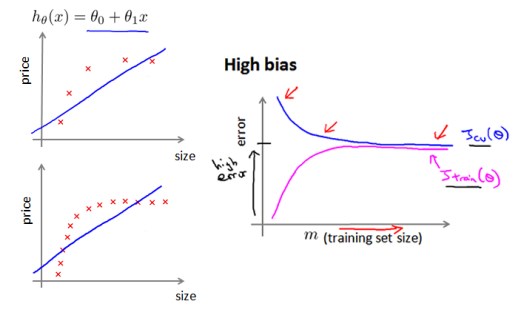

用学习曲线识别低拟合/高偏倚

- 尝试用一条直线来适应下面的数据,可以看出,无论训练集有多么大误差还是很大:

- 说明: 欠拟合/high bias高偏倚 情况下, 训练集再大,也没有用 .

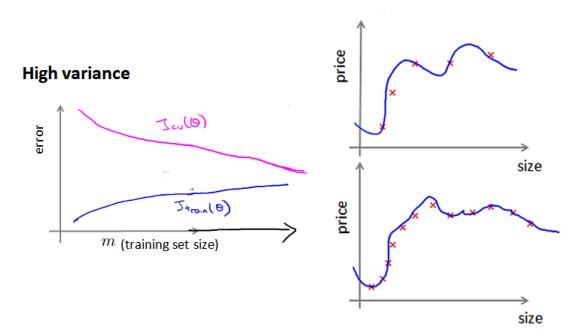

用学习曲线识别过拟合/高偏差

- 当交叉验证集误差远大于训练集误差时(过拟合): 往训练集增加更多数据可以提高模型的效果。

- 过拟合:拟合少部分数据,当训练集足够大时,能够更好的泛化数据。

总结

解决过拟合-高偏差

- 1 获得更多的训练实例;

- 2 尝试减少特征的数量;

- 3 尝试增加归一化程度$\lambda$ ;

解决欠拟合-高偏倚

- 4 尝试获得更多的特征;

- 5 尝试更复杂的模型–如增加二项式特征;

- 6 尝试减少归一化程度$\lambda$ ;

神经网络的偏倚/偏差

- 使用较小的神经网络,类似于参数较少的情况,容易导致高偏倚/低拟合,但计算代价较小;

- 使用较大的神经网络,类似于参数较多的情况,容易导致高偏差/过拟合,虽然计算代价比较大,但是可以通过归一化手段来调整而更加适应数据。;

通常选择较大的神经网络并采用归一化处理会比采用较小的神经网络效果要好。;

对于神经网络中的隐藏层的层数的选择,通常从一层开始逐渐增加层数,为了更好地作选择,可以把数据分为训练集、交叉验证集和测试集,针对不同隐藏层层数的神经网络训练神经网络,然后选择交叉验证集代价最小的神经网络。